Votre système a l’air solide… jusqu’au jour où il vous trahit ! 5 secrets pour une souveraineté numérique qui dure – Chapitre 7 – 8/13

mai 4, 2026 | by Jean-Yves M.

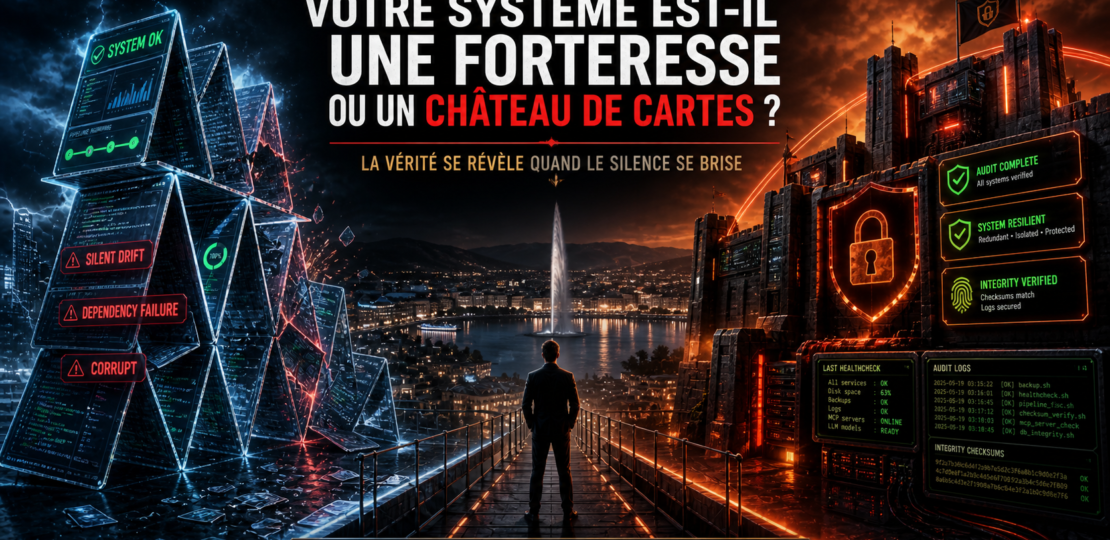

Votre système est-il une forteresse ou un château de cartes ? 5 secrets pour une souveraineté numérique qui dure

Introduction : Le silence trompeur du tableau de bord au vert

Votre infrastructure tourne depuis six semaines sans le moindre incident. Les pipelines s’exécutent, les rapports s’accumulent et votre tableau de bord affiche un vert éclatant. C’est précisément à cet instant que tout peut basculer. En tant que stratège, je vous le dis : le danger le plus critique pour un système numérique ne réside pas dans la panne franche, mais dans le silence qui précède la dérive.

.

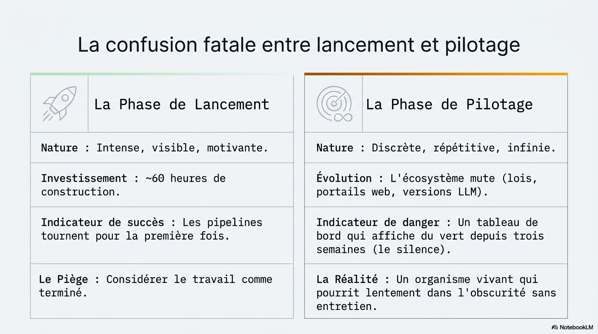

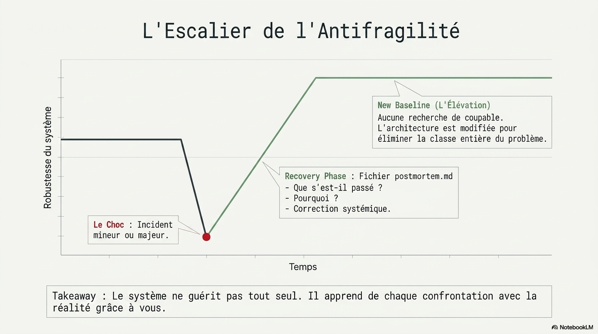

La plupart des entrepreneurs commettent une erreur fatale en confondant le lancement d’un système avec son pilotage sur le long terme. Construire une infrastructure est un acte gratifiant et visible ; la maintenir est une discipline ingrate, répétitive et pourtant vitale. L’objectif n’est pas seulement de posséder un outil fonctionnel, mais de transformer une structure potentiellement fragile en un organisme « antifragile » capable de se renforcer au contact des imprévus.

1. Briser l’illusion du « Lancer et Oublier »

Un système qu’on n’entretient pas devient un piège silencieux. On investit souvent 60 heures dans la construction initiale pour ensuite abandonner le pilotage une fois que « ça marche ». C’est ici que la fragilité s’installe.

.

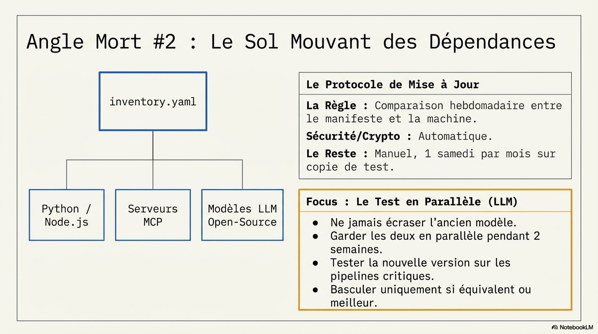

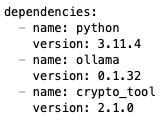

Chaque changement mineur — une mise à jour de bibliothèque Python qui casse un parseur, une réforme fiscale non anticipée ou une modification de formulaire sur un portail gouvernemental — est bénin lorsqu’il est pris isolément. Mais accumulés sur six mois, ces micro-événements corrompent le système. Pour contrer cela, la première action immédiate est la création d’un fichier inventory.yaml à la racine de votre système, listant chaque dépendance et sa version exacte. Sans cet inventaire, vous construisez sur un sol qui bouge.

.

« Une forteresse numérique n’est pas un monument figé. C’est un organisme vivant. Les lois changent. Les dépendances logicielles évoluent. Chacun de ces événements, pris isolément, est bénin. Accumulés sur six mois sans surveillance, ils transforment un système précis en générateur d’erreurs silencieux. »

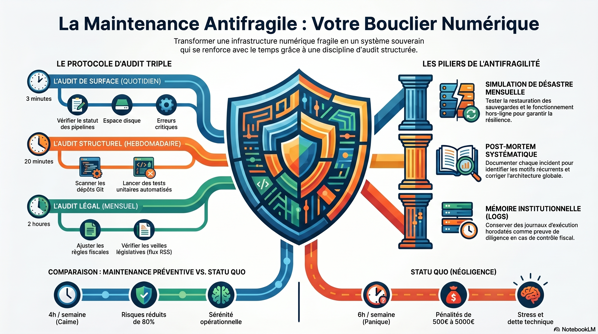

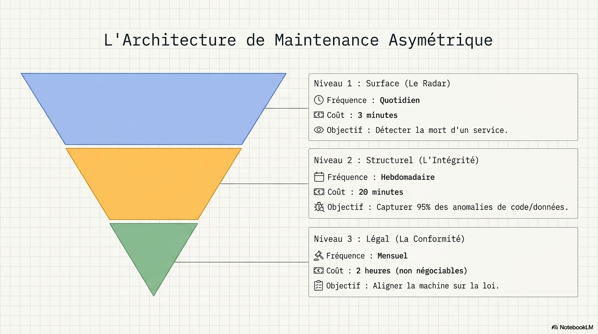

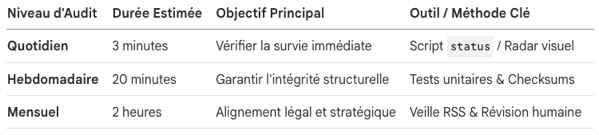

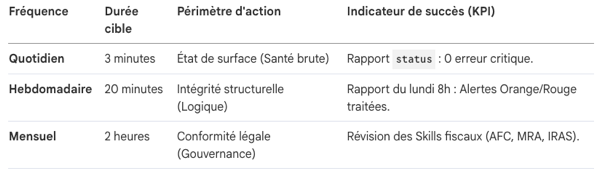

2. La règle d’or des trois niveaux d’audit (3, 20, 120)

Pour garantir une hygiène numérique sans y passer ses journées, l’audit doit être structuré autour d’un protocole de fréquences strictes, intégré à votre arborescence PARA :

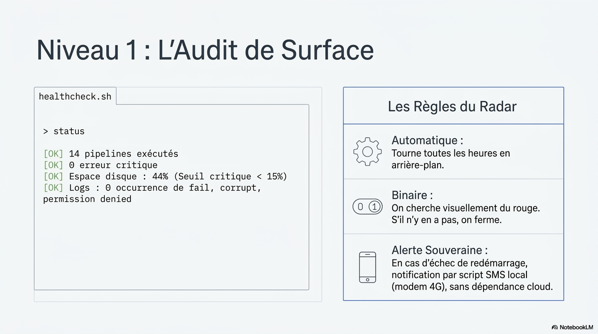

- Quotidien (3 minutes) : L’audit de surface. C’est votre radar. Un script status vérifie les services critiques (modèles locaux, serveurs MCP). Il alerte si l’espace disque tombe sous les 15 % et scanne les journaux pour les mots-clés « fail » ou « corrupt ». L’exigence antifragile : En cas d’échec, le système vous alerte via un script SMS local sur un modem 4G physique, éliminant toute dépendance aux services cloud de notification.

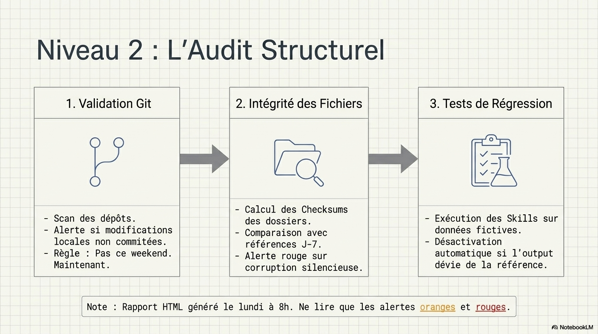

- Hebdomadaire (20 minutes) : L’audit structurel. Vous vérifiez que chaque modification est enregistrée dans Git. Un script calcule les checksums de vos dossiers Projets et Domaines pour détecter toute corruption silencieuse. On lance ici les tests unitaires de vos Skills pour s’assurer qu’aucun changement de bibliothèque n’a altéré les résultats.

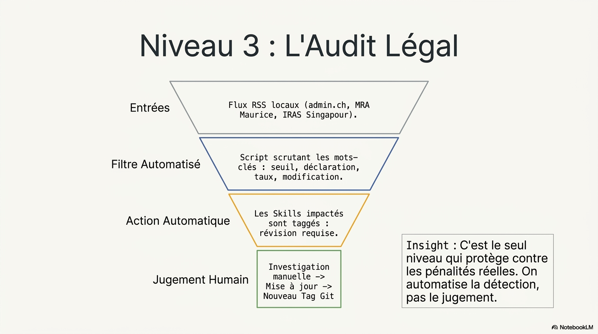

- Mensuel (120 minutes) : L’audit légal. C’est le pilier de votre souveraineté. Vous utilisez une veille automatisée par flux RSS pour surveiller les bulletins officiels des administrations clés : l’AFC (Suisse), la MRA (Maurice) ou l’IRAS (Singapour). Dès que les mots « seuil » ou « taux » apparaissent, vos Skills fiscaux sont marqués pour révision humaine.

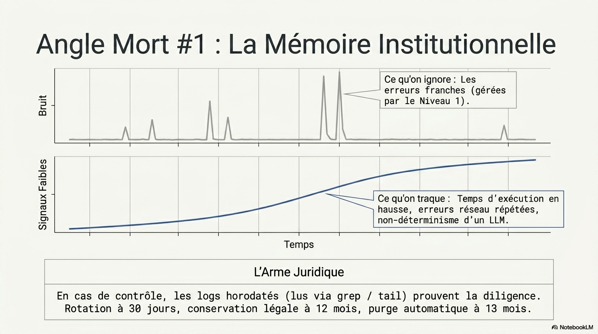

3. Les journaux d’exécution, votre armure juridique

Le dossier Logs/ de votre système PARA constitue sa mémoire institutionnelle. Chaque opération doit y laisser une trace standardisée : timestamp, commande, durée, code de retour et output.

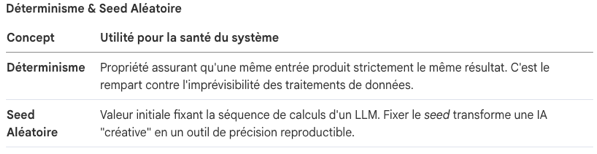

Au-delà de la détection de pannes, ces journaux permettent d’identifier les « signaux faibles ». Une dérive du temps d’exécution ou un comportement non déterministe d’un modèle LLM (nécessitant de fixer le random seed pour garantir la reproductibilité) sont des alertes avant-coureurs d’une défaillance majeure.

Sur le plan légal, ces journaux sont une preuve de diligence inestimable. En cas de contrôle administratif, présenter un journal horodaté et signé par un checksum prouve que vous avez détecté et corrigé une anomalie dès sa survenance. Pour maintenir la performance, une rotation automatique archive ces fichiers sur 12 mois avant purge.

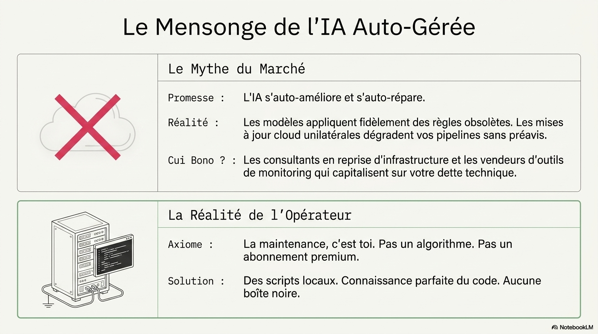

4. Le mythe de l’IA auto-réparatrice : Cui Bono ?

Le marketing de la Silicon Valley veut vous faire croire que l’IA s’auto-maintient. C’est une illusion dangereuse. Un modèle de langage n’identifie pas de lui-même l’obsolescence d’une règle fiscale ; il applique fidèlement ce que vous lui avez fourni, même si cela est devenu faux.

La maintenance est une responsabilité personnelle. Posez-vous la question : Cui bono ? (À qui profite la négligence ?). Elle profite aux consultants facturant des interventions d’urgence et aux éditeurs de logiciels de monitoring complexes. En écrivant vos propres scripts d’audit, vous brisez cette dépendance. Votre souveraineté réside dans la maîtrise de chaque ligne de code de votre surveillance.

5. L’Antifragilité par la simulation du chaos

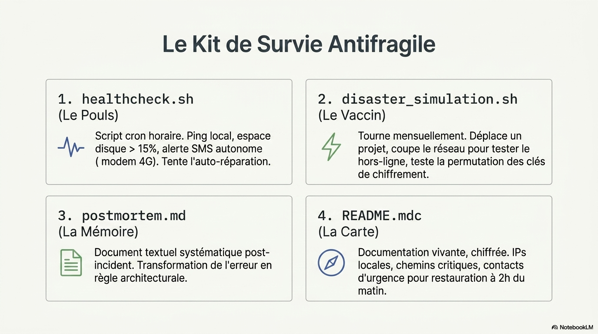

Un système robuste ne se contente pas de survivre ; il apprend. Cela nécessite trois outils stratégiques :

- Le script healthcheck.sh : Lancé toutes les heures, il tente des corrections automatiques (redémarrage de services, purge de caches) avant de déclencher l’alerte SMS.

- La simulation de désastre (disaster_simulation.sh) : Une fois par mois, simulez une panne réseau totale ou une corruption de données. Si vous ne pouvez pas restaurer votre système en moins de 30 minutes grâce à votre README.mdc (votre carte d’infrastructure chiffrée), vous n’êtes pas protégé.

- Le postmortem.md : À chaque incident, documentez le « quoi », le « pourquoi » et la correction systémique apportée. Ce fichier est le cerveau de votre infrastructure ; il transforme chaque défaillance en une amélioration structurelle de l’architecture.

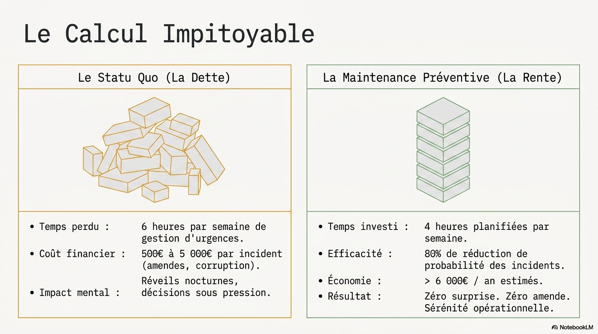

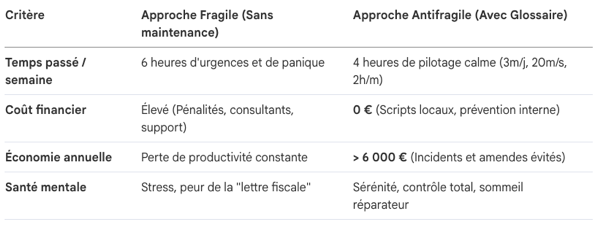

Le calcul impitoyable : Rentabilité de la maintenance

La maintenance préventive n’est pas une charge, c’est un investissement à haut rendement :

- Le temps : 4 heures planifiées par semaine remplacent en moyenne 6 heures de gestion d’urgences stressantes. Vous gagnez 2 heures de sérénité.

- Le coût de l’inaction : Un incident moyen (déclaration erronée, sauvegarde corrompue) coûte entre 500 et 5 000 euros en pénalités et temps perdu.

- L’économie réelle : Pour un entrepreneur actif, la maintenance préventive permet d’économiser plus de 6 000 euros par an en évitant les interventions de consultants et les amendes administratives.

Conclusion : De l’inquiétude à la sérénité opérationnelle

La maintenance préventive transforme le chaos numérique en un travail prévisible. Elle remplace la peur de la dérive par la certitude d’un système sous contrôle total. La sérénité opérationnelle est un actif invisible dont la valeur dépasse largement les économies financières réalisées.

.

À quand remonte la dernière fois où vous avez réellement lancé une simulation de désastre ou vérifié que vos journaux de sécurité n’étaient pas devenus de simples fichiers vides par manque de permissions ?

——-

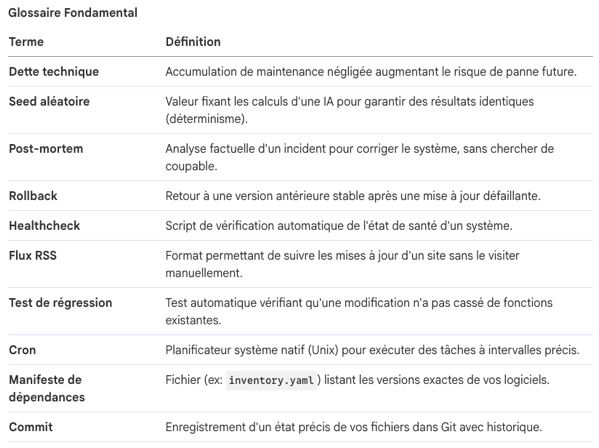

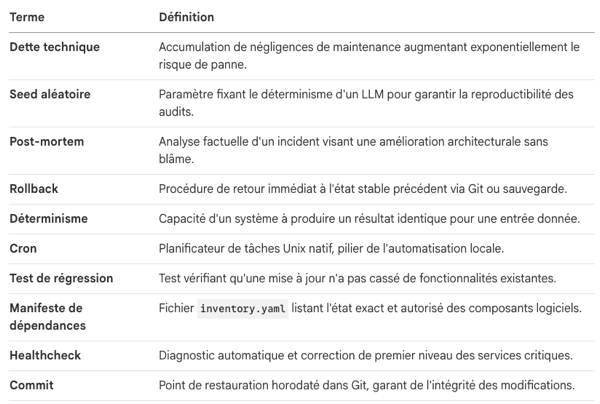

Glossaire Commenté : Les Fondations de l’Infrastructure Antifragile

1. Introduction : La Maintenance comme Acte de Souveraineté

Dans l’architecture d’un système souverain, la terminologie n’est pas un simple décorum technique ; elle est la carte de navigation qui empêche votre infrastructure de muter en un piège hors de contrôle. Ignorer ces concepts, c’est accepter de naviguer à vue dans un environnement où la moindre dérive législative ou technique peut s’avérer fatale.

Une distinction fondamentale sépare l’amateur de l’expert :

- Le Lancement : Phase visible, gratifiante et intense où l’on bâtit. C’est le moment de l’excitation créative.

- Le Pilotage : Phase discrète, répétitive et stratégique. C’est ici que se joue la souveraineté. Piloter, c’est maintenir une vigilance constante pour que le système ne s’érode pas sous le poids des mises à jour fantômes ou des réformes fiscales invisibles.

Sans une nomenclature rigoureuse, le pilotage est impossible. Pour maîtriser son destin technique, il faut d’abord savoir nommer les forces qui régissent l’équilibre du système.

2. Le Cœur du Système : Stabilité et Prévisibilité

L’infrastructure antifragile repose sur une fondation de béton armé : la prévisibilité. Sans elle, votre système n’est qu’un « générateur d’erreurs silencieux » qui finira par vous trahir au moment le plus critique, souvent lors d’un contrôle administratif.

En fixant le seed, vous neutralisez la dérive des modèles de langage. C’est une mesure de sécurité vitale pour les Skills traitant des calculs fiscaux ou des documents juridiques où l’aléa n’a pas sa place.

Dette Technique : Le « Cui Bono ? » de la Négligence

La dette technique est l’accumulation de compromis, de correctifs rapides et de maintenance ignorée. Mais à qui profite ce crime ? Cui bono ? Elle enrichit systématiquement les cabinets de conseil en « reprise d’infrastructure » et les fournisseurs cloud qui facturent votre dépendance et votre panique.

Elle naît de trois racines toxiques :

- Compromis de conception : Choisir la facilité immédiate au détriment de la structure.

- Correctifs « pansements » : Masquer les symptômes sans traiter la pathologie.

- Négligence opérationnelle : Oublier les mises à jour, laissant le sol bouger sous vos pieds.

La discipline du pilotage est l’unique antidote à cette hémorragie de souveraineté. Pour combattre cette dette, l’architecte déploie des sentinelles capables de détecter les signaux faibles avant l’explosion.

3. Les Sentinelles de l’Audit Continu

L’hygiène numérique n’est pas une inspection annuelle, mais un radar permanent. L’audit sérieux se décline en trois fréquences temporelles immuables, garantissant que vous ne découvrez pas une faille le jour où l’administration fiscale vous écrit.

- Cron & Healthcheck (Audit de surface – 3 min quotidiennes) : Le script healthcheck.sh s’exécute chaque heure via Cron. Il ne cherche pas l’exhaustivité, mais la survie : espace disque (alerte si < 15%), réponse des services locaux (modèles Ollama, serveurs MCP) et absence de mots-clés critiques (fail, corrupt). En cas de défaillance majeure, l'alerte doit être locale : un script SMS via un modem 4G physique, sans aucune dépendance à un service cloud de notification.

- Flux RSS (Veille législative – 2 h mensuelles) : Loin du gadget médiatique, le RSS est une couche de défense juridique. Un script surveille les flux officiels (AFC en Suisse, MRA à Maurice, IRAS à Singapour). Toute mention de « taux », « seuil » ou « modification » marque immédiatement le Skill concerné pour une révision obligatoire.

- Test de Régression (Audit structurel – 20 min hebdomadaires) : Lors de chaque mise à jour de Skill, des tests automatisés comparent les sorties avec des jeux de données de référence. Si un seul octet diffère de la norme attendue, le Skill est désactivé avant d’empoisonner votre production.

La surveillance en temps réel n’est cependant qu’une partie de l’équation. Sans une mémoire institutionnelle indélébile, vous restez aveugle face à l’histoire de vos propres décisions.

4. La Mémoire Institutionnelle et l’Intégrité des Données

Un système sans traçabilité est une boîte noire. Dans une optique de souveraineté, les journaux ne sont pas que des fichiers techniques ; ils sont votre preuve de diligence face aux régulateurs.

Journaux d’exécution (Logs)

Logés dans le dossier PARA/Logs/, ces fichiers bruts se lisent via grep ou tail. Ils servent à traquer les signaux faibles :

- Erreurs réseau récurrentes : Un serveur MCP qui échoue sporadiquement annonce une panne systémique imminente.

- Augmentation du temps d’exécution : Un Skill qui ralentit trahit souvent une base de données qui sature ou une dépendance dégradée.

- Dérive des sorties : Des variations subtiles indiquant que votre modèle LLM a besoin d’un réglage de seed.

[!TIP] Valeur Juridique : Conservez vos logs 12 mois. En cas de contrôle, produire un journal horodaté prouvant que vous avez corrigé une anomalie le 16 mars pour une déclaration le 20 mars rend votre défense inattaquable.

Commit & Manifeste de Dépendances (inventory.yaml)

L’architecte ne tolère aucune modification « volante ».

- Commit : Chaque ajustement de script doit être enregistré dans Git instantanément. C’est la règle du « Maintenant, pas ce soir ».

- Inventory.yaml : C’est le manifeste qui fige votre sol. Il liste chaque bibliothèque avec sa version exacte :

C’est l’antidote ultime aux mises à jour silencieuses qui brisent les systèmes complexes. Une fois cette mémoire assurée, l’infrastructure devient capable d’apprendre de ses propres crises.

5. Résilience et Apprentissage par l’Incident

L’objectif n’est pas l’absence de pannes (impossible), mais l’antifragilité : le système doit devenir plus fort après chaque choc.

- Post-mortem : Après chaque incident, un fichier postmortem.md doit être créé. Il suit une structure stricte : Ce qui s’est passé / Pourquoi / Action corrective systémique. L’absence totale de recherche de coupable est la clé d’un apprentissage honnête.

- Rollback & Versioning LLM : Le retour en arrière doit être immédiat. Pour les modèles d’IA, la prudence souveraine impose de garder l’ancienne version et la nouvelle en parallèle pendant deux semaines. On ne bascule définitivement que si les tests de régression confirment l’absence de dégradation sur les tâches critiques.

Cette rigueur transforme la maintenance d’une corvée subie en un avantage compétitif et financier impitoyable.

6. Synthèse : Le Calcul Impitoyable de la Valeur

L’approche antifragile n’est pas un luxe, c’est une optimisation comptable.

Conclusion majeure : La maintenance préventive ne coûte rien, elle rapporte. Elle transforme 6 heures de chaos en 4 heures de maîtrise. Elle permet d’éliminer 80% des risques systémiques en remplaçant la panique par des procédures.

Appel à l’action : Ne laissez pas votre souveraineté s’éroder. Ouvrez votre dossier PARA et créez dès aujourd’hui votre premier fichier postmortem.md pour documenter votre dernier incident numérique, aussi minime soit-il. C’est l’acte de naissance de votre forteresse numérique.

——-

Manuel de Méthodologie : L’Art de l’Audit Continu

1. Introduction : Pourquoi votre système « pourrit » en silence

Le succès d’un projet numérique ne se mesure pas à sa mise en service, mais à sa capacité à perdurer. La plupart des entrepreneurs tombent dans un piège classique : ils considèrent qu’une fois le système construit, le travail est terminé. C’est précisément à cet instant que la fragilité s’installe.

Un système non entretenu subit une dégradation invisible. Alors que vos tableaux de bord affichent du vert, des erreurs silencieuses s’accumulent : un taux fiscal devenu obsolète, une bibliothèque logicielle qui casse un processus après une mise à jour automatique, ou un script de sauvegarde qui échoue suite à un changement de chemin système. Pour garantir votre souveraineté, vous devez distinguer deux phases :

Les trois types de dérives silencieuses

Sans une surveillance active de votre « forteresse numérique », vous vous exposez à trois risques majeurs :

- Dérive Fiscale : Un changement de loi (taux ou seuil) non répercuté dans vos outils peut entraîner des pénalités lourdes lors d’un contrôle.

- Dérive Technique : Des permissions système qui changent ou des disques qui se saturent finissent par bloquer les processus vitaux.

- Dérive Logicielle : Les mises à jour de bibliothèques ou les évolutions des modèles d’IA peuvent altérer la qualité de vos résultats sans prévenir (régressions).

Pour éviter ce chaos, il convient de structurer sa surveillance selon trois fréquences précises, formant une pyramide de vigilance protectrice.

2. La Pyramide de l’Audit Continu : Trois Niveaux de Vigilance

L’hygiène numérique sérieuse ne consiste pas à tout vérifier tout le temps, mais à appliquer la bonne intensité au bon moment. Pour un système en régime de croisière, cette discipline garantit la paix de l’esprit.

Le concept de « Radar » vs « Exhaustivité »

Pour le néophyte, la clé est de comprendre que l’audit quotidien n’est pas une inspection profonde. C’est un radar : on cherche uniquement les signaux critiques. Si tout semble normal, on n’investigue pas. L’exhaustivité est réservée aux sessions hebdomadaires et mensuelles, permettant de maintenir la charge mentale au plus bas.

Explorons maintenant le détail de la routine quotidienne, celle qui assure que votre système a survécu à la nuit.

3. Niveau 1 : L’Audit de Surface (Quotidien)

Cette routine matinale est votre première ligne de défense. Elle doit être si courte qu’elle devient une habitude aussi naturelle que de vérifier ses emails.

La routine des 3 minutes

Chaque matin, une commande unique (type status) résume l’état de santé du système. Ce script est lancé automatiquement chaque heure par cron (le planificateur natif) et vérifie :

- Espace disque : Alerte immédiate si moins de 15% d’espace libre.

- Erreurs critiques : Recherche des mots-clés « fail », « corrupt » ou « permission denied » dans les journaux des dernières 24h.

- Sauvegardes : Confirmation que la sauvegarde nocturne (ex: 03h47) a bien été générée.

- Services actifs : Vérification que vos modèles locaux (Ollama) et serveurs critiques répondent.

La règle du « Chercher le rouge »

La philosophie est simple : si tout est vert, on ferme. En cas d’anomalie grave que le système ne peut réparer seul, une notification vous est envoyée. Pour rester souverain et indépendant du cloud, privilégiez un script envoyant un SMS via un modem 4G local branché sur votre machine.

Si le quotidien gère l’immédiat, le niveau hebdomadaire s’occupe de l’intégrité profonde de la structure.

4. Niveau 2 : L’Audit Structurel (Hebdomadaire)

Réalisé idéalement le dimanche soir, cet audit de 20 minutes repose sur trois scripts automatisés qui valident la solidité de votre travail.

- Script Git / Versions : Vérifie que toutes les modifications ont été « commitées ». Rien ne doit rester « en l’air » sans trace historique.

- Script Checksums : Compare l’empreinte numérique de vos fichiers avec la référence de la semaine précédente. Un changement inattendu signale une corruption silencieuse.

- Tests Unitaires : Relance vos outils (Skills) sur des données fictives pour vérifier que les résultats (sorties) sont toujours identiques aux attentes.

Le Rapport du Lundi Matin

Les résultats sont compilés dans un rapport HTML visuel disponible dès votre réveil le lundi.

Conseil d’expert : Ne regardez que le orange et le rouge. Le vert est une information inutile qui consomme votre attention pour rien.

Toutefois, la technique ne suffit pas si les règles du jeu (la loi) changent, d’où l’importance du troisième niveau.

5. Niveau 3 : L’Audit Légal et Stratégique (Mensuel)

C’est une session de deux heures, non négociable, où l’humain reprend le contrôle sur la machine pour valider les fondations de son activité.

Automatiser la détection, garder le jugement

Vous ne pouvez pas automatiser l’interprétation d’une nouvelle réforme, mais vous pouvez automatiser sa détection. Utilisez des flux RSS pour surveiller les bulletins officiels des juridictions clés (Suisse : admin.ch, Maurice : MRA, Singapour : IRAS).

Mots-clés prioritaires à surveiller dans vos flux :

- Seuil (ex: seuils de TVA ou de déclaration).

- Taux (ex: modification d’impôt sur les sociétés).

- Modification (tout changement de texte réglementaire).

Cette discipline est votre seule protection réelle contre les pénalités administratives, transformant une veille subie en une stratégie de conformité proactive.

6. La Mémoire du Système : Journaux et Inventaire

Un système souverain doit pouvoir justifier ses actions. C’est le rôle des journaux d’exécution (Logs/), votre mémoire institutionnelle.

Chercher les signaux faibles

Au-delà des pannes, les journaux permettent d’anticiper les crises :

- Erreurs réseau récurrentes : Un service qui commence à faiblir.

- Temps d’exécution croissant : Un script qui ralentit signale souvent une base de données qui sature.

- Non-déterminisme des LLM : Vérifiez que vos modèles d’IA produisent toujours les mêmes résultats sur les mêmes entrées en fixant le seed (graine aléatoire).

La gestion rigoureuse des logs et de l’inventaire

Pour éviter la saturation du disque, appliquez la règle de rotation : archivez à 30 jours et purgez définitivement à 13 mois.

L’autre pilier est le fichier inventory.yaml (votre manifeste de dépendances), qui liste les versions exactes de vos outils (Python, Ollama, outils de chiffrement).

Exemple de structure inventory.yaml :

En cas de contrôle fiscal, ces journaux constituent une Preuve de diligence. Si un inspecteur vous demande de justifier trois ans d’activité, vous pouvez prouver par les logs horodatés que chaque erreur a été détectée et corrigée en temps réel.

7. Vers l’Antifragilité : Apprendre de chaque incident

L’objectif n’est pas d’avoir un système parfait, mais un système qui se renforce à chaque erreur rencontrée.

Les 4 piliers de la réponse antifragile

1. healthcheck.sh : Un script tournant via cron qui tente des réparations automatiques (redémarrage de service) avant de vous alerter.

2. Simulation de désastre : Testez mensuellement trois scénarios : (1) Corruption d’un projet aléatoire, (2) Coupure réseau totale (test offline), et (3) Rotation de vos clés de chiffrement.

3. Post-mortem : Documentez chaque incident dans postmortem.md :

- Ce qui s’est passé (faits).

- Pourquoi (cause racine).

- Changement systémique (quelle modification empêchera la récurrence).

4. Documentation vivante : Utilisez un fichier README.mdc centralisé avec vos procédures de secours.

Le calcul impitoyable

La maintenance préventive (4h/semaine en régime de croisière) remplace avantageusement les 6h par semaine de gestion d’urgences stressantes subies par ceux qui négligent leur système.

Cui bono ? Votre paresse technique alimente directement le business model des consultants en urgence et des fournisseurs cloud « boîte noire ». En maîtrisant votre audit, vous reprenez votre indépendance financière et mentale.

8. Lexique et Prochaines Étapes

Actions Immédiates

- Créer un dossier Logs/ : Configurez vos scripts pour qu’ils y écrivent une ligne (date, heure, résultat) à chaque exécution.

- Initialiser un inventory.yaml : Listez les 5 logiciels ou bibliothèques les plus critiques de votre système avec leur version actuelle.

- Configurer une alerte RSS : Abonnez-vous au flux officiel de l’administration fiscale de votre juridiction (ex: admin.ch pour la Suisse) pour détecter les changements de taux.

—–

Plan de Continuité d’Activité : Stratégie de Souveraineté et d’Antifragilité Numérique

1. Cadre Stratégique : De la Maintenance Subie à la Résilience Souveraine

Dans l’architecture d’un système numérique souverain, la continuité d’activité n’est pas une option technique, mais un impératif de survie opérationnelle. Le pilotage est une discipline de combat qui commence précisément là où le lancement s’arrête. Trop d’opérateurs succombent à la « confusion fatale » en investissant massivement dans la construction pour ensuite abandonner le système à une dérive silencieuse. Sans une maintenance rigoureuse, l’infrastructure la plus sophistiquée devient, en quelques mois, un nid de vulnérabilités législatives et techniques prêtes à s’effondrer au premier contrôle fiscal.

L’excellence résiliente impose de concevoir le système non comme un « monument figé », voué à l’érosion, mais comme un « organisme vivant ». Un monument subit les éléments ; un organisme s’adapte et se renforce au contact des agressions. Cette transformation d’une infrastructure vulnérable en une forteresse antifragile repose sur une discipline de maintenance impitoyable. Elle seule permet de détecter les signaux faibles avant qu’ils ne mutent en crises systémiques, garantissant ainsi que le système se bonifie avec le temps au lieu de pourrir dans l’obscurité. Cette dynamique de survie exige une surveillance multicouche permanente.

2. Le Dispositif d’Audit Continu en Trois Fréquences

Le maintien d’une hygiène numérique irréprochable est l’unique rempart contre la « confusion fatale » entre un tableau de bord au vert et une réalité opérationnelle corrompue. L’architecture de surveillance est structurée autour de trois fréquences critiques :

1. L’Audit de Surface (Quotidien – 3 minutes) : Ce « radar » automatisé s’exécute chaque matin pour valider l’intégrité immédiate.

- Objectifs : Vérification de la disponibilité des services critiques (modèles locaux, serveurs MCP).

- Alertes : Déclenchement d’une alerte prioritaire si l’espace disque est inférieur à 15%.

- Notification : En cas de défaillance persistante après tentative de redémarrage automatique, envoi d’une alerte via SMS/4G locale, sans aucune dépendance aux services Cloud.

2. L’Audit Structurel (Hebdomadaire – 20 minutes le dimanche soir) : Une inspection profonde visant à détecter la corruption silencieuse.

- Intégrité : Calcul et comparaison des checksums sur les répertoires « Projets » et « Domaines ».

- Versionnage : Scan des dépôts Git pour identifier toute modification non commitée.

- Validation : Exécution de tests unitaires sur les « Skills » logiciels via des jeux de données de référence pour garantir la stabilité des sorties.

3. L’Audit Légal (Mensuel – 2 heures, un samedi par mois) : Prévention de l’obsolescence réglementaire.

- Veille Active : Surveillance automatisée des flux RSS des administrations cibles : AFC (Suisse), MRA (Maurice) et IRAS (Singapour).

- Révision : Analyse humaine des Skills marqués « révision requise » suite à la détection de mots-clés (taux, seuils, réformes).

- Certification : Mise à jour systématique du champ LastReviewDate dans l’en-tête YAML de chaque Skill.

Cette surveillance ne prend tout son sens que si elle génère une trace indélébile, transformant la donnée brute en actif stratégique.

3. Traçabilité et Mémoire Institutionnelle : Le Levier de Preuve Juridique

Les journaux d’exécution (logs) constituent le bouclier légal de l’opérateur souverain. Face aux administrations (AFC, MRA, IRAS), ils transforment une gestion technique en une « preuve de diligence » inattaquable lors d’un contrôle fiscal.

Standards de Formatage et Analyse des Signaux Faibles

Pour garantir leur valeur probante, les logs respectent un standard brut et rigoureux :

- Format : [Timestamp] | [Commande] | [Durée] | [Code de retour] | [Checksum du résultat].

- Diagnostic des Signaux Faibles : L’analyse ne traque pas seulement l’erreur, mais la dérive. Une augmentation progressive du temps d’exécution sur quatre semaines signale souvent une dépendance qui ralentit ou un fichier source qui s’alourdit anormalement. De même, toute variation de sortie sur une entrée identique révèle un non-déterminisme des LLM, imposant la fixation immédiate du « seed » aléatoire.

Politique de Conservation et Purge Automatisée

La mémoire institutionnelle est protégée par une rotation stricte :

- 30 jours : Conservation en phase active pour l’analyse opérationnelle immédiate.

- 12 mois : Archivage compressé pour garantir la conformité légale annuelle.

- 13 mois : Purge automatique définitive pour prévenir la saturation disque et respecter le cycle de vie des données.

Cette rigueur dans la traçabilité est la seule méthode permettant de vérifier si une mise à jour de dépendance a introduit une régression silencieuse dans les processus décisionnels.

4. Gestion de la Dette Technique et Maîtrise des Dépendances

Le marché vend l’illusion de l' »auto-réparation » par l’IA. En réalité, un modèle ne détecte jamais de lui-même son obsolescence légale. La maîtrise de la dette technique exige un contrôle total sur les composants externes via un manifeste d’inventaire rigoureux.

Le Manifeste inventory.yaml

Chaque dépendance (Python, serveurs MCP, outils de chiffrement) est consignée dans un fichier inventory.yaml à la racine, précisant la version installée et la version minimale requise.

Stratégie de Mise à Jour Sécurisée

- Automatisme Restreint : Seules les bibliothèques liées à la cryptographie et aux accès réseau sont autorisées à recevoir des mises à jour de sécurité automatiques.

- Maintenance Manuelle : Les évolutions fonctionnelles sont traitées un samedi par mois.

- Protocole LLM : Toute nouvelle version de modèle impose une exécution en parallèle pendant deux semaines. La bascule n’est validée qu’après confirmation de l’absence de régression sur les tâches juridiques et fiscales, avec fixation du seed pour garantir le déterminisme.

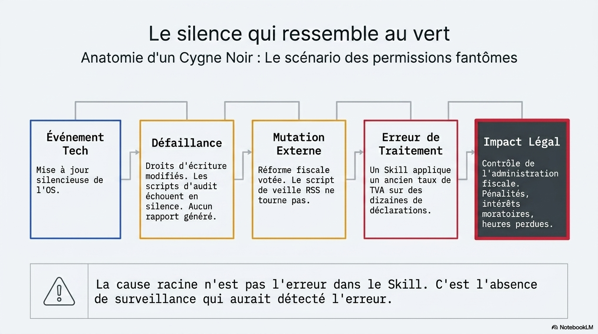

Cette maîtrise est le seul rempart contre les scénarios de rupture imprévus, ou « Cygnes Noirs ».

5. Réponse aux Scénarios « Cygne Noir » et Simulation de Désastres

L’antifragilité se bâtit par la simulation active de l’imprévisible. Ignorer les risques systémiques revient à les accepter au moment le plus critique.

Analyse des Risques Systémiques

- Permissions Fantômes : Risque d’échec silencieux des scripts d’audit suite à une mise à jour d’OS modifiant les droits d’écriture.

- Ransomware sur Modifications Non-Commitées : Perte de précision irrécupérable sur des Skills en cours d’ajustement. Règle absolue : commit immédiat.

- Dette Technique Explosive : Défaillance en chaîne de bibliothèques obsolètes lors d’une sollicitation critique du système.

Le Protocole de Simulation disaster_simulation.sh

Une simulation mensuelle doit impérativement exécuter les instructions suivantes :

- Test de Restauration : Déplacer un projet actif vers un dossier /Corrupted, déclencher la restauration depuis les sauvegardes et valider un retour à la normale en moins de 30 minutes.

- Test d’Autonomie : Désactiver l’interface réseau (down) et exécuter l’intégralité des pipelines critiques pour confirmer le fonctionnement 100% hors-ligne.

- Test de Chiffrement : Permuter les clés de chiffrement sur un volume de test et vérifier l’intégrité de l’accès avec les nouvelles procédures de secours.

6. Protocole de Restauration et Apprentissage Antifragile

Chaque incident est une opportunité de renforcement architectural. Le système doit apprendre de chaque choc pour réduire asymptotiquement sa probabilité de défaillance.

- Le Post-Mortem Stratégique : Tout incident génère un fichier postmortem.md structuré en trois sections : Faits (chronologie), Causes (analyse racine), et Actions Correctives (modifications systémiques).

- La Documentation Vivante : Le fichier README.mdc fait office de carte de navigation chiffrée. Il contient les IP, les chemins critiques et les procédures de secours. Sans ce fichier, toute restauration sous stress est vouée à l’échec.

- Indicateur de Santé : Le script healthcheck.sh assure la remédiation automatique (redémarrage de services, purge de logs) et l’alerte hors-ligne. Chaque Skill intègre son champ LastReviewDate pour forcer la vigilance humaine.

7. Analyse de Rentabilité du Plan de Continuité

La maintenance préventive n’est pas un coût, c’est un investissement à haut rendement. Le calcul est impitoyable :

- Investissement : 4 heures par semaine (audit quotidien, rapport hebdomadaire, veille mensuelle).

- Économie : Élimination de 6 heures par semaine d’urgences numériques chaotiques et de stress décisionnel.

- Impact Financier : En réduisant les risques de déclarations erronées et de pertes d’exploitation, cette stratégie génère une économie structurelle supérieure à 6 000 € par an.

La sérénité opérationnelle ainsi acquise est le véritable moteur de la prise de décision stratégique. La souveraineté technologique ne se décrète pas au lancement ; elle se conquiert chaque jour par une discipline opérationnelle inflexible. C’est l’unique voie pour transformer une infrastructure vulnérable en un système souverain, pérenne et véritablement antifragile.

—–

Protocole de Maintenance : Intégrité et Souveraineté de l’Infrastructure Numérique

1. Philosophie de la Maintenance Souveraine et Antifragile

Pour l’Architecte en Systèmes Numériques, la maintenance n’est pas une servitude technique, mais le socle de la souveraineté opérationnelle. La fragilité d’un système s’installe dans la latence entre la phase de lancement — portée par l’enthousiasme du bâtisseur — et la phase de pilotage, qui exige la rigueur froide du gestionnaire de risques.

Le danger réside dans la dérive silencieuse. Un système qui semble « vert » en surface peut pourrir de l’intérieur : une bibliothèque Python mise à jour automatiquement qui corrompt un parseur de PDF, ou une réforme fiscale ignorée transformant un Skill précis en générateur de déclarations erronées. La « Forteresse Numérique » ne doit pas être un monument statique, mais un organisme idempotent capable de maintenir son état cible malgré les pressions externes. Ignorer cette vigilance, c’est accepter que l’infrastructure devienne un passif juridique. La transition vers l’antifragilité commence là où s’arrête l’improvisation.

2. Le Cadre Opérationnel des Trois Niveaux d’Audit

La hiérarchisation des fréquences est impérative pour prévenir la fatigue opérationnelle. Le protocole segmente la surveillance en trois couches d’abstraction croissante.

Audit de Surface (Quotidien) : Le Radar Unix

Chaque matin, l’opérateur exécute le script status. Ce radar local interroge l’infrastructure sans dépendance au cloud. Il vérifie :

- L’espace disque : Seuil d’alerte critique à 15% de libre.

- L’état des services : Disponibilité des serveurs MCP (Playwright, etc.) et des modèles LLM locaux.

- L’intégrité des logs : Recherche de mots-clés (fail, corrupt, permission denied).

Output attendu : « Audit OK. 14 pipelines exécutés hier. 0 erreur critique. Dernière sauvegarde : 03h47. Espace disque : 44%. » En cas d’échec de redémarrage automatique, le système déclenche une alerte via un modem SMS 4G local, garantissant la réception du signal même en cas de coupure réseau internet.

Audit Structurel (Hebdomadaire) : L’Intégrité PARA

Effectué via Cron, cet audit valide l’intégrité de la structure PARA :

- Validation Git : Scan des dépôts pour identifier toute modification non commitée.

- Calcul de Checksums : Comparaison des empreintes numériques des fichiers de projet pour détecter les corruptions silencieuses.

- Tests de régression : Exécution des tests unitaires sur les Skills avec des jeux de données de référence. Un écart de sortie entraîne la désactivation immédiate du Skill.

Audit Légal (Mensuel) : Veille multi-juridictionnelle

L’automatisation de la détection de changement est la clé. Le protocole impose la surveillance des flux RSS officiels :

- AFC (Suisse), MRA (Maurice), IRAS (Singapour).

- Mots-clés surveillés : « seuil », « déclaration », « taux », « modification ». Toute occurrence marque automatiquement les Skills concernés du tag révision requise, bloquant leur usage en production jusqu’à validation humaine.

3. La Mémoire Institutionnelle : Gestion et Exploitation des Journaux

Les journaux d’exécution (logs) constituent un actif juridique et une preuve de diligence. En cas de contrôle fiscal, ils documentent l’historique des corrections et l’intégrité des données.

- Standardisation : Chaque pipeline écrit dans le répertoire Logs/ de la structure PARA (Format : Timestamp | Commande | Durée | Exit Code).

- Signaux Faibles : L’analyse via grep et tail ne cible pas que les erreurs. L’opérateur surveille le creep du temps d’exécution et les erreurs réseau intermittentes des serveurs MCP, précurseurs de défaillances systémiques.

- Déterminisme LLM : Pour l’auditabilité, fixer le seed aléatoire est obligatoire. Une sortie qui varie sur une même entrée brise la chaîne de preuve.

- Rotation : Rétention de 30 jours (accès direct), archivage compressé de 12 mois (conformité), purge automatique à 13 mois par script Unix.

4. Maîtrise des Dépendances et Gestion du Risque Logiciel

Les dépendances externes sont l’angle mort de la souveraineté. Le système doit être traité comme un environnement scellé.

- Manifeste de dépendances : Le fichier inventory.yaml répertorie chaque bibliothèque et version de modèle LLM. Toute divergence détectée par le script hebdomadaire bloque le système.

- Protocole de mise à jour sécurisé :

- sécurité (Crypto/Réseau) : Mises à jour automatiques via gestionnaire de paquets.

- Fonctionnel : Mise à jour manuelle impérative le samedi, après test sur environnement miroir et validation des tests de régression.

- Versioning LLM : Lors de la sortie d’un nouveau modèle open-source, l’ancienne version est conservée en parallèle pendant 14 jours. Le basculement n’intervient qu’après validation de la non-dégradation des tâches juridiques.

5. Antifragilité en Action : Transformation des Incidents

L’antifragilité n’est pas la résistance, mais la capacité à s’améliorer après un choc.

- Surveillance Active (healthcheck.sh) : Script horaire (Cron) qui tente l’auto-réparation (redémarrage de service, purge de cache) avant d’alerter par SMS.

- Simulation de Désastre (disaster_simulation.sh) : Test mensuel de restauration.

- * KPI critique : Rétablissement complet en moins de 30 minutes.

- * Scénarios : Corruption de fichiers, coupure réseau totale, rotation des clés de chiffrement.

- Post-Mortem Systémique : Chaque incident génère un fichier postmortem.md (Fait | Cause Racine | Correction Systémique). L’objectif est d’identifier les patterns récurrents pour modifier l’architecture plutôt que de traiter les symptômes.

6. Documentation Vivante et Actifs de Secours

La documentation doit être indissociable du code. Nous utilisons des fichiers .mdc (Context files pour éditeurs IA type Cursor) pour garantir que l’intelligence artificielle respecte les contraintes du système.

- Métadonnées : Chaque Skill doit inclure le champ LastReviewDate.

- Le Pivot README.mdc : Situé à la racine, il contient la topographie critique (IP locales, chemins PARA, procédures de restauration d’urgence, contacts). Ce fichier chiffré est le premier actif à consulter en mode dégradé.

7. Synthèse de la Valeur et Calcul de Rentabilité

Le passage d’une maintenance réactive à une maintenance planifiée est un arbitrage économique impitoyable.

Le Bilan Temporel :

- Investissement : 4 heures / semaine de maintenance prévisible.

- Coût de l’inaction : ~6 heures / semaine de gestion d’urgences (stress, panique, perte de données).

Le Bilan Financier : Une seule erreur fiscale ou une perte de données coûte entre 500 € et 5 000 € en pénalités et temps de reconstruction. L’investissement préventif génère un gain net estimé à plus de 6 000 € par an pour un entrepreneur multi-juridictionnel.

Action immédiate : Implémenter le script healthcheck.sh et initialiser le fichier postmortem.md. La souveraineté ne se délègue pas, elle s’exécute.

8. Lexique de la Maintenance Souveraine

RELATED POSTS

View all